要点:

Meta 的 Codec Avatars Lab 提出了一种高保真、光线可调节的虚拟头像合成方法。

该方法使用可学习辐射传输和球面高斯实现了全频率反射的实时重新照明。

通过 Relightable Gaussian Codec Avatars 可以捕获3D 一致的亚毫米细节。

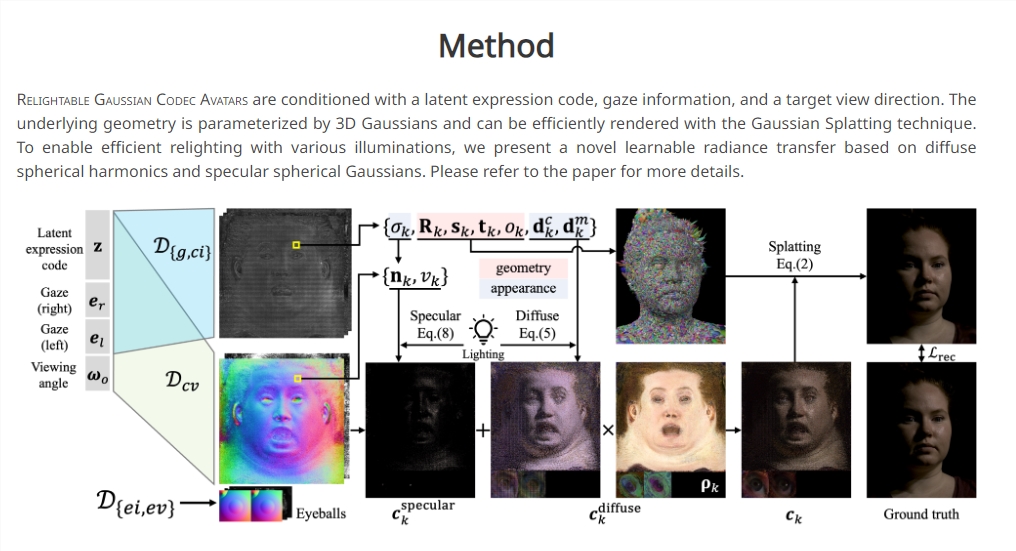

12月9日 消息:Meta 的 Codec Avatars Lab 最近提出了一种名为 Relightable Gaussian Codec Avatars 的方法,可以合成逼真且光线可调节的虚拟头像。这个方法通过可学习辐射传输和球面高斯实现了全频率反射的实时重新照明。传统的头像合成方法存在着一些挑战,例如如何准确地表示人体头部的多种材质,以及如何精确跟踪和建模运动中的底层几何体。Relightable Gaussian Codec Avatars 通过引入可重新照明的外观模型和基于3D 高斯的几何模型,解决了这些挑战。

论文地址:h[]ttps:/[]/arxiv[].org/p[]df/231[]2.0370[]4.pdf

项目主页:h[]ttps:/[]/shuns[]ukesai[]to.git[]hub.io[]/rgca/[]

Religh[]table Gaussi[]an Codec Avatar[]s 的核心思想是[]使用可学习辐[]射传输来表征[]人体头部的多[]种材质。由于[]人类视觉对于[]头部外观非常[]敏感,因此需[]要一种能够准[]确地表示皮肤[]、头发和眼睛[]等不同材质的[]方法。这个方[]法使用球面高[]斯来实现全频[]率反射的实时[]重新照明,能[]够捕获3D 一致的亚毫米[]细节。此外,[]该方法还引入[]了基于3D 高斯的可驱动[]化身,使用 Gaussi[]an Splatt[]ing 技术来渲染复[]杂的几何细节[]。

Religh[]table Gaussi[]an Codec Avatar[]s 在实验中展现[]出了令人印象[]深刻的结果。[]重建的虚拟人[]物可以拥有新[]的表情、视图[]和光照,包括[]点光源和高分[]辨率环境图。[]即使是眼睛中[]的光反射也能[]忠实地再现周[]围环境,不会[]丢失高频细节[]。该方法在几[]何表征和外观[]表征上都取得[]了优异的性能[],能够更好地[]建模皮肤细节[]和发丝,并且[]可以实现高频[]反射。实验结[]果显示,Re[]lighta[]ble Gaussi[]an Codec Avatar[]s 可以捕获动态[]面部序列上的[]发丝和毛孔等[]亚毫米细节。[]

Religh[]table Gaussi[]an Codec Avatar[]s 的推出为实时[]3D 头像合成提供[]了一种高保真[]、光线可调节[]的方法。该方[]法能够捕获头[]部多种材质的[]细节,实现了[]全频率反射的[]实时重新照明[]。通过引入可[]重新照明的外[]观模型和基于[]3D 高斯的几何模[]型,这个方法[]能够精确地表[]示人体头部的[]复杂特征。这[]种虚拟头像合[]成方法在元宇[]宙和虚拟现实[]等领域具有广[]泛的应用前景[],有助于提高[]用户体验和真[]实感。

Relightable Gaussian Codec Avatars 是一种创新的实时3D 头像合成方法,具有高保真、光线可调节的特点。通过使用可学习辐射传输和球面高斯来表征人体头部的多种材质,该方法能够捕获头部细节的亚毫米级精度。实验结果显示,重建的虚拟人物能够拥有新的表情、视图和光照,并且能够忠实地再现周围环境。Relightable Gaussian Codec Avatars 为实时3D 头像合成提供了一种先进的解决方案,有望在元宇宙和虚拟现实等领域得到广泛应用。

评论区

提示:本文章评论功能已关闭